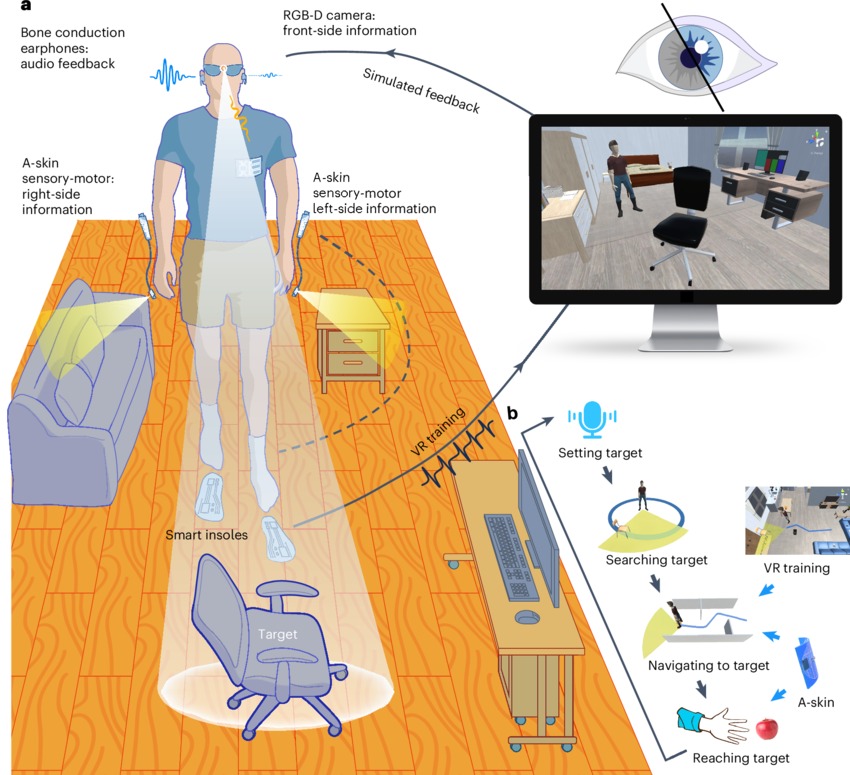

La movilidad exterior autónoma sigue siendo uno de los grandes retos pendientes de la accesibilidad. Decenas de millones de personas con discapacidad visual dependen todavía de ayudas humanas o referencias memorizadas para desplazarse con seguridad. El motivo no es la ausencia de tecnología, sino su precisión limitada.

El GPS integrado en los smartphones, aunque útil, presenta márgenes de error de varios metros. En la navegación peatonal, esa diferencia no es trivial: puede implicar girar antes de tiempo, no localizar un cruce o desviarse hacia una zona peligrosa. La orientación asistida actual funciona, pero no siempre con la exactitud que exige quien depende totalmente de ella. Continuar leyendo “Vector: la navegación táctil de precisión que anticipa una nueva generación de movilidad asistida”